はじめに

AIに関する法律やガイドラインは現在急速に整備が進んでいる分野です。地域や国によって異なり、様々な枠組みやアプローチがあります。本稿では代表的なものをいくつかご紹介します。

EUのAI規制

EUでは “AI法 (Artificial Intelligence Act)” として知られる包括的な規制が整備されています。

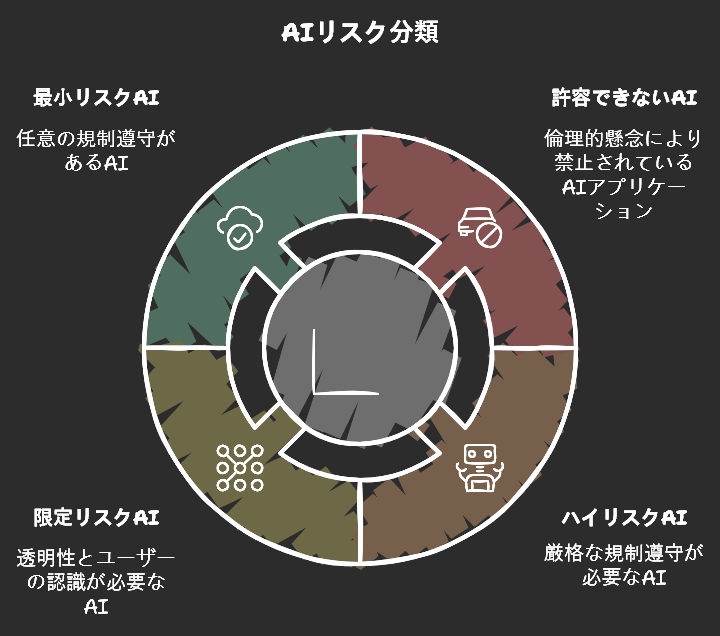

この法律ではAI利用がもたらすリスクの高低によってAIを4つに分類し、異なる規制を設けています。

リスクが許容できないとされたAIシステムは利用が禁止され、高リスクと判定されたAIシステムは透明性の確保やユーザーへ十分な説明責任を負うなど厳しい条件を満たす必要があります。

これらの規制に違反した場合には厳しい罰則が定められており、たとえEU外の企業であっても、EU市民に対してAIサービスを提供する場合にはこの法律に従う必要があります。

アメリカのAI規制

アメリカではEUのように包括的・統一的な法規制はまだ整備されていません。ただガイドラインはいくつか示されており、例えばホワイトハウス科学技術政策局はAI権利章典 (Blueprint for an AI Bill of Rights) を発表して、AIの設計や利用における人権と倫理の指針を示しています。

また、アメリカでは州ごとにAIに関わるプライバシー規制が異なっており、AIが収集した個人データに対しユーザーがアクセス・削除する権利が与えられていたり、顔認証や指紋認証などのバイオメトリクスデータを利用する場合には、ユーザーの明示的な同意が必要になるケースもあります。

中国のAI規制

中国ではAIの開発と運用を政府が管理しており、特定のAIに関しては特に厳しい規制がかけられています。

例えば生成AIの開発や運用を行う企業は政府から事前に許可を取ることを求められています。

また、所謂 “フェイク” (偽の音声や映像) を生成する技術は社会不安の原因となるとされ、開発や運用には厳しい条件が設けられています。

日本のAI規制

日本では他国に比べ法規制より、ガイドラインや政策提言を中心にAI規制が進んでいます。

例えば総務省と経済産業省が作成したガイドラインでは、AI開発者やAIサービス提供だけでなく、AI利用者対しても指針を示しています。

また、特定の分野に技術に関するガイドラインも整備され始めています。

医療分野では厚生労働省が、金融分野では日本銀行や金融庁がそれぞれAI活用についてガイドラインを設けています。

同様に自動運転技術やドローンなどへのAI技術の導入に関しては、安全性の確保を目的として国土交通省が法整備を進めています。

終わりに

現在も地域や国、様々な分野毎にAIに関する法律やガイドラインが整備され続けています。

AIを利用する/開発・運用する場合には、常に最新の状況を確認することが重要です。